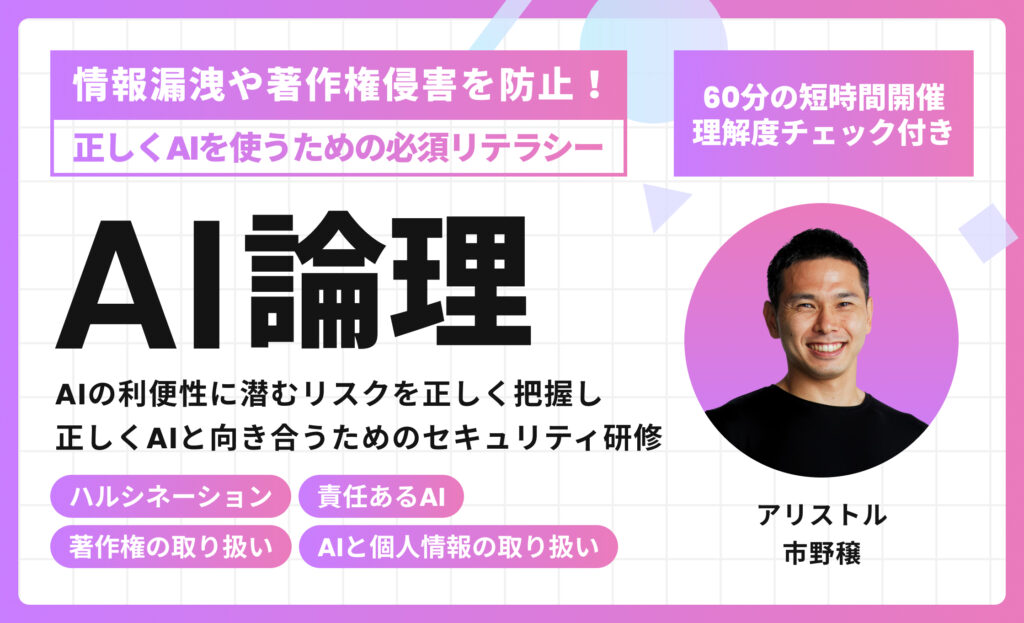

生成AIの利便性の裏には、情報漏洩や著作権侵害といった重大なリスクが潜んでいます。AI利用を禁止するのではなく、正しく恐れながら活用するためには、全社員がリスクの所在と回避方法を理解しておく必要があります。

本講座では、比較的短時間で、想定されるセキュリティ事故事例をもとに、やってはいけない「NG行動」をクイズ形式で学習します。また、ファクトチェックの方法や、著作権に配慮した生成物の利用法など、実務で迷わないための判断基準を養います。

講座の終了後に行う理解度テストも実施可能です。雛型も事務局に進呈しますのでご自由に活用頂けます。